La precisión y la exactitud de un instrumento de medida son dos conceptos distintos, pero de suma importancia. A continuación, explicamos estos conceptos y cómo realizar un análisis básico de resultados mediante ejemplos.

Contenidos:

Temas relacionados:

El concepto de exactitud no depende del número de veces que se realiza la medición.

| La exactitud es el grado en que un instrumento de medida se acerca al valor real de la magnitud. |

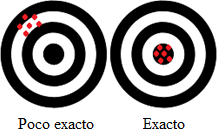

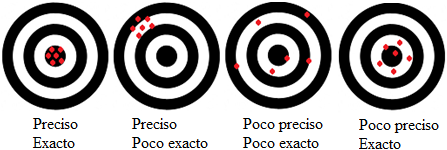

Representación de una diana cuyo centro es el valor real de la magnitud y los disparos son los resultados obtenidos por el instrumento:

Una balanza cuyo resultado se aleja mucho del valor real es poco exacta.

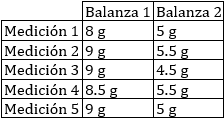

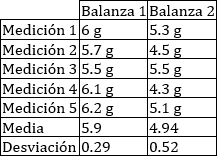

Resultados obtenidos al pesar un objeto de 5 gramos con dos balanzas distintas:

La balanza 2 es más exacta que la balanza 1 porque los resultados que proporciona se acercan más al valor real, que es 5 gramos.

El concepto de precisión sí depende del número de veces que se realiza la medición. No se puede determinar si un instrumento es o no preciso con una sola medición.

| La precisión es el grado en que un instrumento de medida proporciona el mismo resultado al realizar distintas mediciones de la misma magnitud. |

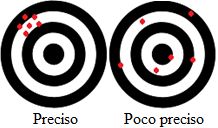

Representación:

Nota: en la diana de la izquierda se han representado resultados cercanos entre sí (precisión), pero alejados del valor real (inexactitud).

Si una balanza proporciona resultados distintos cada vez que se pesa un mismo objeto, la balanza no es precisa.

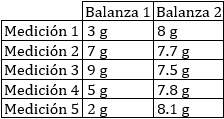

Resultados obtenidos al pesar un objeto de 5 gramos con dos balanzas distintas:

La balanza 1 no es precisa porque proporciona resultados muy alejados entre sí. Sin embargo, la balanza 2 sí es precisa, aunque no es exacta porque los resultados están muy alejados del valor real (5 gramos).

Los conceptos de precisión y exactitud son importantes y a veces se confunden, pero son conceptos muy distintos. Un instrumento de medición puede ser:

| El instrumento ideal es aquél que es exacto y preciso. |

Es más fácil detectar la imprecisión que la inexactitud, ya que la variación entre los resultados llama rápidamente atención. Por esta razón, un instrumento muy preciso pero muy inexacto puede hacernos creer que el instrumento funciona correctamente y llevarnos a cometer grandes errores de cálculo.

Un instrumento perfectamente exacto (ningún error de exactitud) es preciso: siempre proporciona el mismo resultado y es el exacto. Sin embargo, un instrumento perfectamente preciso puede ser muy inexacto: siempre proporciona el mismo resultado, pero está muy alejado del valor real.

| Para evitar posibles errores de precisión y exactitud, debe realizarse una calibración periódica del instrumento. |

Ejemplo: calibración de micropipetas automáticas.

Para analizar la precisión y la exactitud se realiza una calibración. La calibración consiste precisamente en comparar los resultados que proporciona el instrumento y el valor real.

Para un análisis básico puede servirnos calcular la media y la desviación típica o estándar de los resultados obtenidos al medir la misma magnitud un determinado número de veces.

Las fórmulas de la media y la desviación típica son las siguientes:

| $$ \overline{x} = \frac{1}{n}\cdot \sum_{i=1}^n x_i $$ |

| Media |

| $$ S = \sqrt{\frac{1}{n-1}\sum_{i=1}^n (\overline{x} - x_i)^2}$$ |

| Desviación estándar |

Siendo \(n\) el número de datos y \(x_1\), \(x_2\),..., \(x_n\) los datos.

Más información en: parámetros de centralización y de dispersión.

la siguiente tabla recoge los resultados obtenidos al pesar 5 veces un mismo objeto de 5 gramos con dos balanzas distintas:

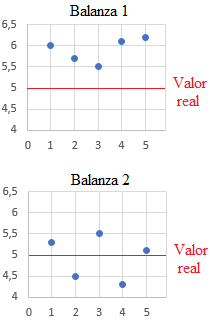

Estas conclusiones también pueden deducirse con la representación gráfica de los datos:

Precisión y exactitud - © - testexamen.com

Testexamen.com

by J. Llopis is licensed under a

Creative

Commons Attribution-NonCommercial 4.0 International License.